本文来自微信公众号: AGENT橘 ,作者:AGENT橘

2026年春节前这周,可以称为中国AI全年成果大展。

一个接一个,根本停不下来。

昨天MiniMax也发布了M2.5,激活参数和M2.1一样只有10B。

M2.1是小龙虾作者Peter最推荐的开源模型。

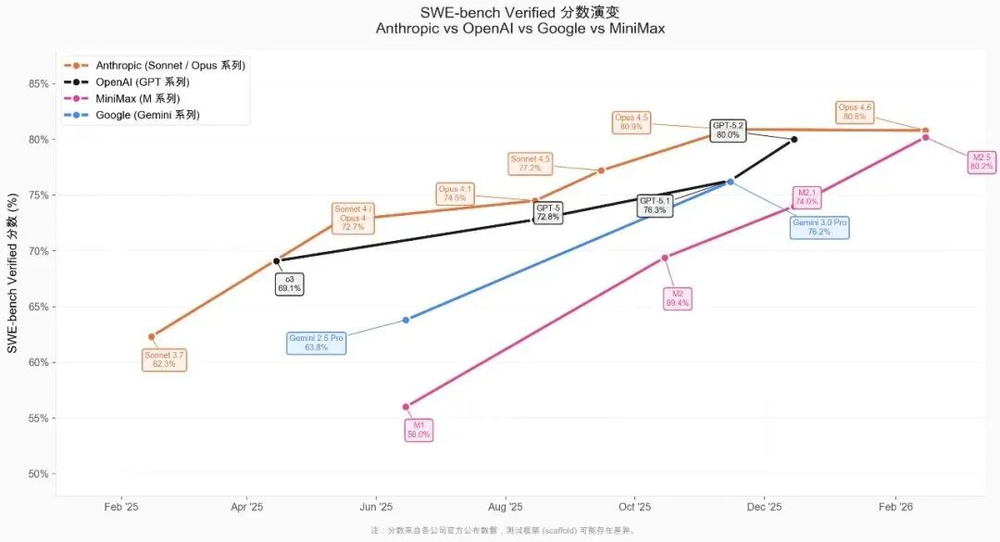

M2.5相比M2.1是一次快速的进化,在编程领域最具代表性的SWE-Bench Verified上,M2系列的进步速度是所有模型系列里最快的,超过了Claude、GPT和Gemini。

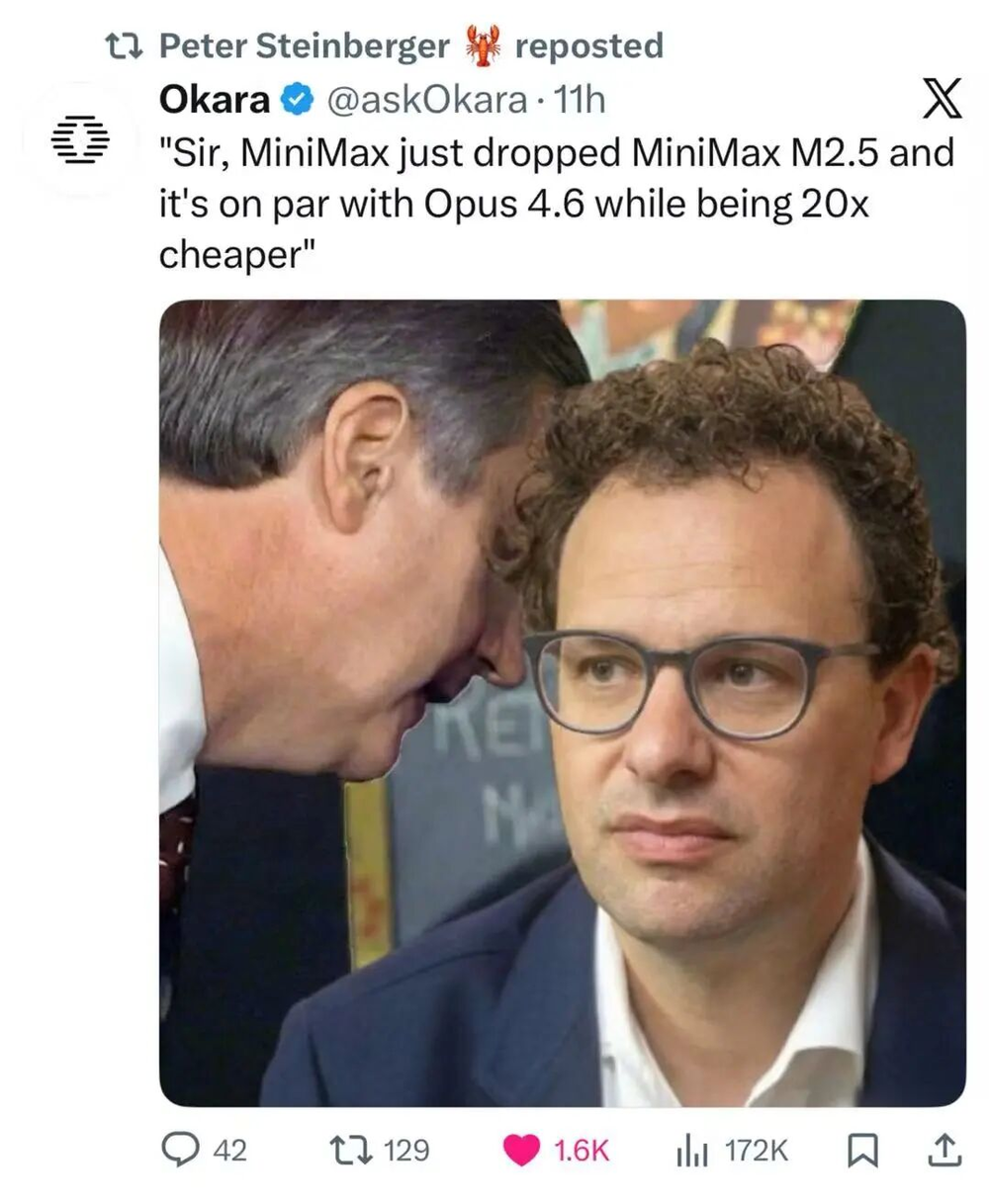

Peter把Opus作为主力模型,MiniMax作为fallback,当Opus的token用完了,自动切换到MiniMax继续跑。

而且他不只是云端调用。他在自己的2台Mac Studio上用MiniMax跑本地推理,不依赖模型厂的套餐,完全本地化,龙虾永远不掉线。

能在本地跑起来,靠的是M2.5在一系列旗舰模型里,拥有最小的激活参数。

M2.5的激活参数只有10B。作为对比,GLM-5激活40B,Kimi K2.5大约50B,DeepSeek V3.2大约30B。

模型的激活参数虽小,但Agent能力却不俗,Peter以及很多🦞用户实测下来,MiniMax是小龙虾里效果最好的开源模型。

参数小带来的好处是连锁反应:推理速度达到100 TPS,几乎是主流旗舰模型的两倍。以这个速度连续工作一小时,成本只要1美金。如果降到50 TPS,只要0.3美金。

这意味着让一个复杂Agent无限运行下去,在经济上变得完全可行了。

Agent和工具调用

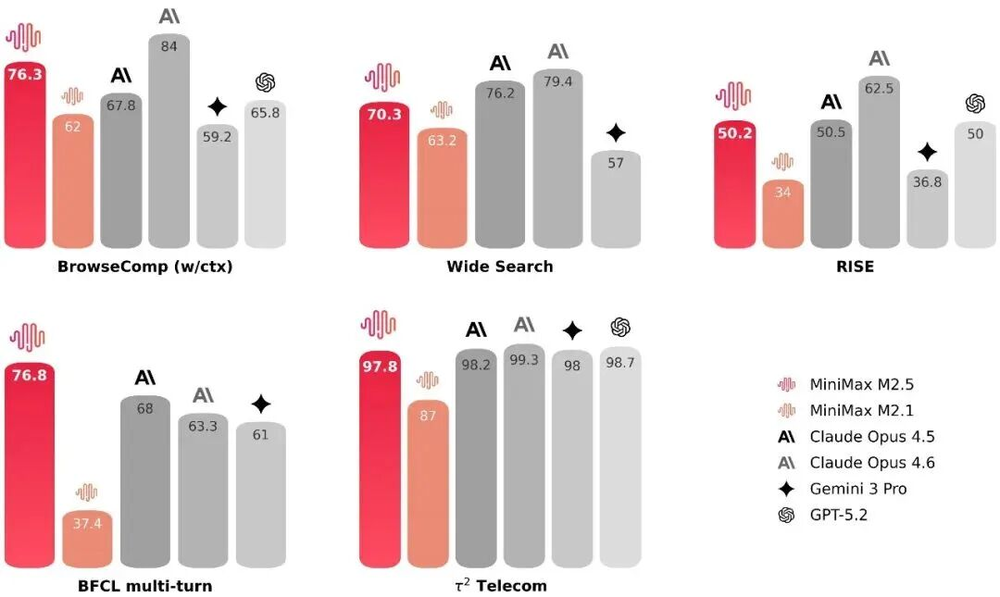

M2.5的工具调用能力非常强悍,在多项工具调用的指标均为头部水平。搜索是Agent最常用的工具,MiniMax为此还自建了一个评测集RISE(Realistic Interactive Search Evaluation),专门测真实专业任务上的搜索能力。

相比M2.1的提升也非常明显。在BrowseComp、Wide Search、RISE多项任务上,M2.5用更少的搜索轮次拿到了更好的结果,轮次消耗少了大约20%。模型学会了用更短的路径逼近答案。

海外开发者Tom Osman用Clawdbot×MiniMax重构日常工作流。他在Telegram、Slack、WhatsApp、iMessage上都部署了龙虾,通过语音或文字随时下指令。一个典型的工作日里,他会让龙虾分析网站、调研信息、撰写博客、更新元数据、起草社交帖子、发送邮件,所有任务并行跑,他只需要在不同的Agent之间切换对话。

他对MiniMax的评价是:在工具调用方面表现非常出色,而且相当准确。用的是每月10美金的Coding Plan,用量远没到上限。

10B的尺寸天然适合这类场景。Agent要7×24小时不停地跑,模型越小,持续运行的成本越低,可行性越高。龙虾作者Peter选MiniMax做Opus的fallback,本质上就是看中了这一点:

当你需要一个Agent一直跑下去的时候,10B的模型能让你真的跑得起。

在我的实际测试中,我让Minimax M2.5来跑一个测试任务。

去监控一下每天有哪些热度最高的小龙虾的skill,它完成得非常好。

编程和泛用性

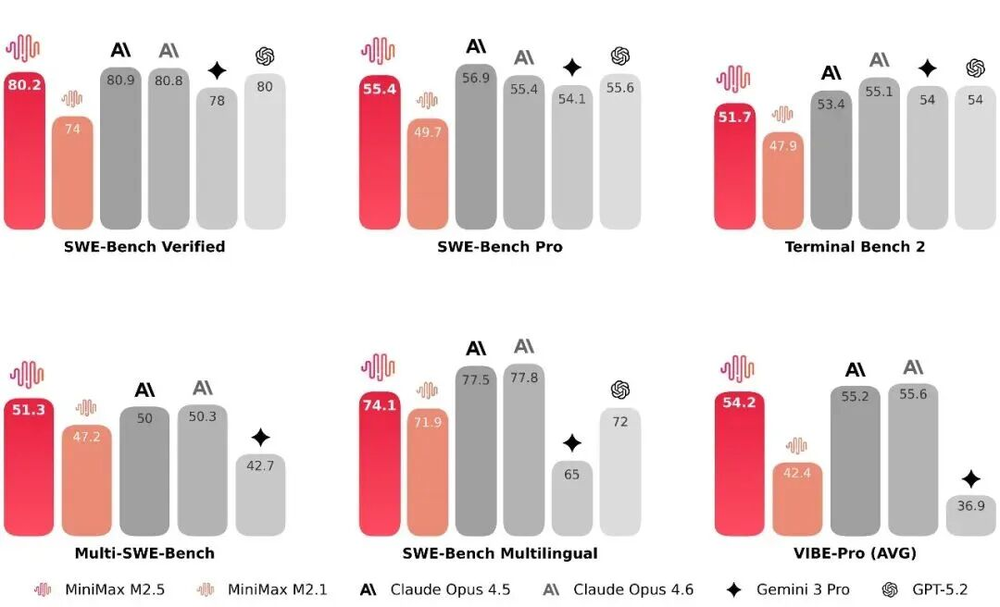

编程方面,M2.5相比M2.1的进步巨大,SWE-bench Verified 80.2%,Multi-SWE-Bench 51.3%拿了全行业第一。

在提升能力的同时,还同时提升了推理速度。端到端完成SWE-bench任务从M2.1的31.3分钟降到22.8分钟,快了37%,跟Opus 4.6的22.9分钟几乎一样。每个任务的token消耗从3.72M降到3.52M。变快了,还变省了。

还有个很有趣的点是M2.5在不同编程客户端里的泛用性很强。在Droid上跑SWE-Bench,M2.5是79.7(Opus 4.6是78.9);在OpenCode上是76.1(Opus 4.6是75.9),这样也就不太依赖Claude Code这而已的闭源脚手架了。

能提升对OpenCode的支持真的是很好的一件事。

OpenCode是Claude Code的开源平替,安装简单,上手容易。

而且里面的MiniMax M2.5是限时免费的,都不需要配置。

我让它写了一个2026年的春运实时监控,每小时自动监控并更新网页,得到的网页是这样的:

从工具到同事:Agent的下一步

MiniMax给M2.5的定位是真实世界的好同事。

这是因为Agent是未来软件的使用者,是每个团队里都会有的新同事。

这个转变一旦发生,对模型的要求就彻底变了。

自主Agent时代,Agent要7×24小时不停地跑,一天几百次推理调用,你在乎的是:能力够不够用、速度快不快、成本扛不扛得住。

那雇佣Agent一年大概需要多少钱呢?

M2.5有两个版本,快速版本在以每秒输出100个token的情况下,连续工作一小时只需要1美金,而慢速版在每秒输出50个token的情况下,只需要0.3美金。

算下来,雇佣Agent让它们7x24地工作,每个Agent的月薪才200美金,你只需要花一万美金,就能获得四个永不休息的同事。

未来几年算力供给是线性增长,需求是指数增长,Token只会越来越稀缺。

在这个大背景下,自主Agent时代能7x24持续运转极为重要。

因为只有这样,Agent才能走向真实世界,成为你真正的同事。