本文来自微信公众号: 爱范儿 ,作者:发现明日趋势的,原文标题:《黄仁勋骗了所有人,DLSS 5 真是个纯 AI 滤镜》

英伟达卖铲子,卖得比任何人都好。

这没什么问题,本来就是一门好生意。

只是卖铲子的人,从来不会在乎挖出来的是什么。

GTC 2026的现场Q&A上,有人问黄仁勋,外界批评DLSS 5只是帧级后处理,只是一个滤镜。

黄仁勋霸气回击:「你们完全搞错了。这不是帧级后处理,这是几何层面的生成控制(generative control at the geometry level)。」

这句话后来传得很广。英伟达的官方声明也配合着说:「DLSS 5将游戏的颜色和运动矢量输入模型,将输出锚定在源3D内容中(anchoring the output in the source 3D content)。」

听起来很有底气,也很快打消了业界的一部分质疑与批评。

但这些话没有说服Daniel Owen,一个游戏技术视频博主。

自从DLSS 5发布以来,Owen不停地重看英伟达的官方视频,翻找DLSS 5的相关官方技术文档和资料,试图找到破绽。

他无论如何都无法相信,黄仁勋说的话是真的。

他联系上了英伟达公司的GeForce专家Jacob Freeman,问了一个最直接的问题:

DLSS 5是否实际上只以单帧2D图像加运动矢量作为输入来生成输出帧?

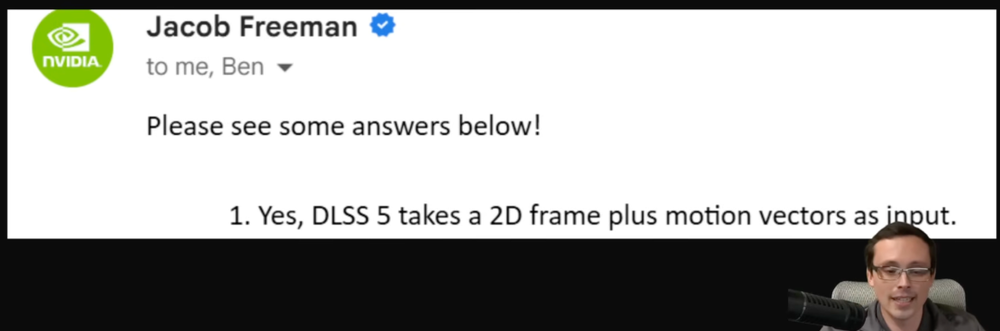

英伟达方面的回答是:是的。

黄仁勋说「几何层面的生成控制」,Freeman说「2D帧加运动矢量」。这两句话描述的是同一个产品。

CEO在台上面对质疑,即兴表演。然而真相却并非如此。

英伟达骗了所有人。

🔗原视频:https://www.youtube.com/watch?v=D0EM1vKt36s

DLSS 5的实际原理

DLSS 5的工作流程实际上是这样的:

1.游戏引擎渲染出一帧画面,

2.这帧画面连同运动矢量一起传给AI模型,

3.模型在上面生成一层「更真实」的光线和材质效果,输出给你看。

DLSS 5从来没有读取游戏素材的几何数据,甚至没有读取深度缓冲中的数据。

DLSS 5的工作也不依赖Shader和光线追踪——它根本就不会读取来自游戏引擎的任何基于物理的渲染(PBR)方面的数据。

是的,DLSS 5会无视游戏开发者为材质标注的细节,例如金属度、粗糙度、法线贴图等等。它不知道NPC身上穿的衣服是棉布还是皮革,它也不知道主角的发量是饱满还是地中海。

DLSS 5只知道在当前这一帧上,用它认为最合理的方式去强行「美化」画面中的一切。

没错,是靠「猜」的。

根据Owen从英伟达布道师那里获得的答案,DLSS 5模型从最终的2D渲染帧里「推断(infer)」材质属性。

它受过大量训练,能识别头发、皮肤、织物,能判断光线方向。

但它判断的依据,只有你眼睛已经看到的那张图。

之前,英伟达官方对外宣称,DLSS 5「将输出锚定在源3D内容中」,但实际上它锚定的只是那张2D渲染结果,而不是任何一层3D数据。

「锚定在源内容中」和「以源内容为唯一的输入,然后加上AI滤镜」,是两件完全不同的事情。

举一个最直接的例子:

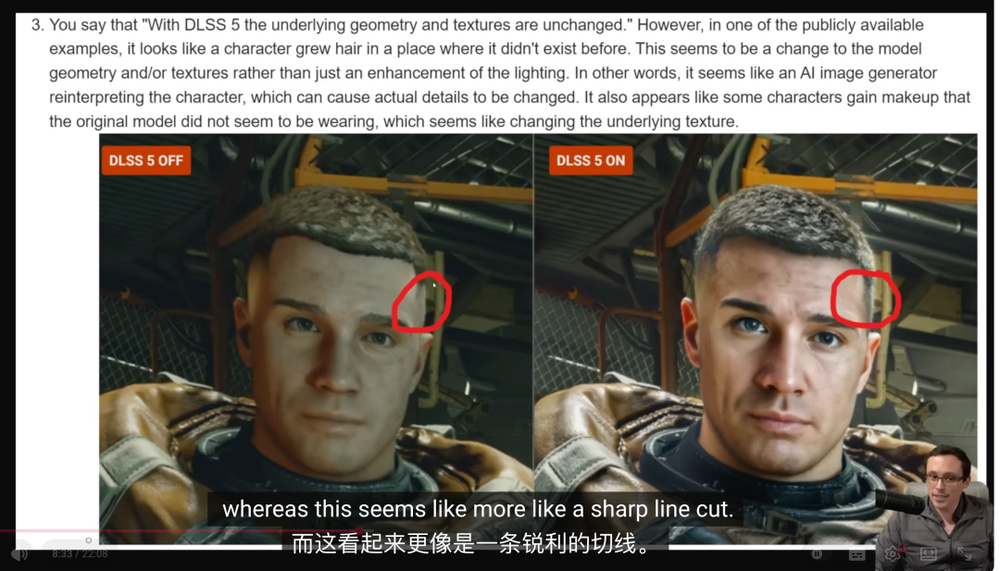

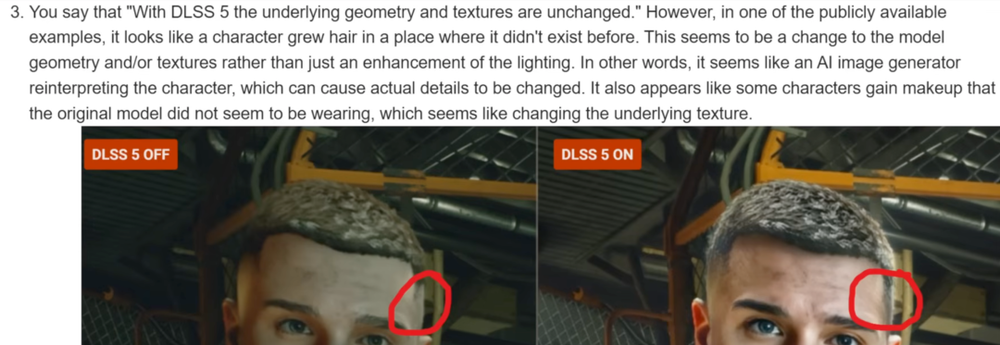

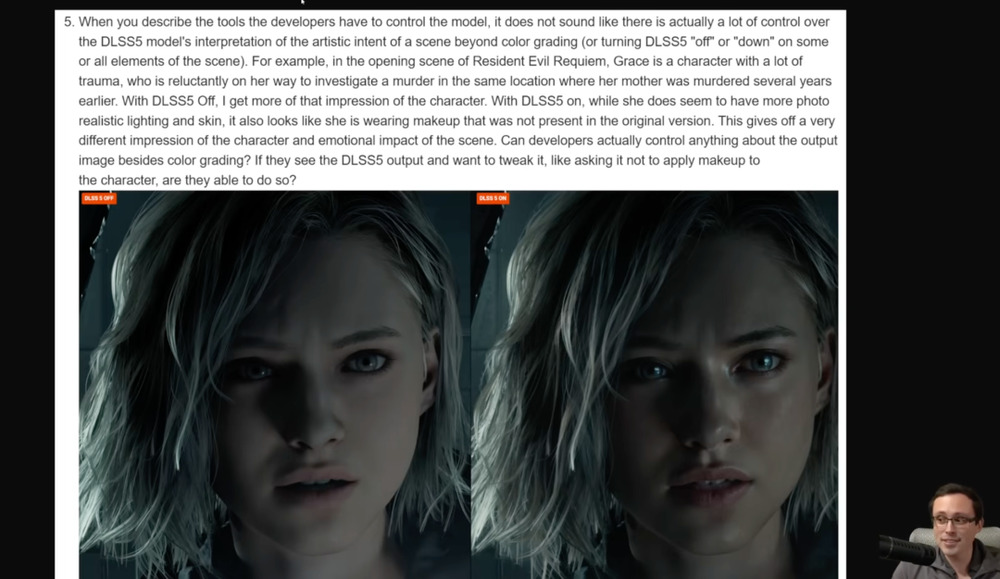

下图中的人物,在游戏原素材中是高渐层的发型,两侧耳上是几乎没有长度的。然而在开启DLSS 5后,头发的长度被篡改了。

你甚至可以看到,DLSS 5生成后的发型,两侧长度出现了不对称的情况。

以及,未开启DLSS 5的原场景中,人物后方的光源照亮了他的右侧耳后——这个光线效果在DLSS 5生成的版本中也消失了。整个人物被均匀打亮,像是开了直播补光灯,破坏了开发者/美术原本的场景设计。

Owen给英伟达方面发了好几个问题,我们一条一条来看。

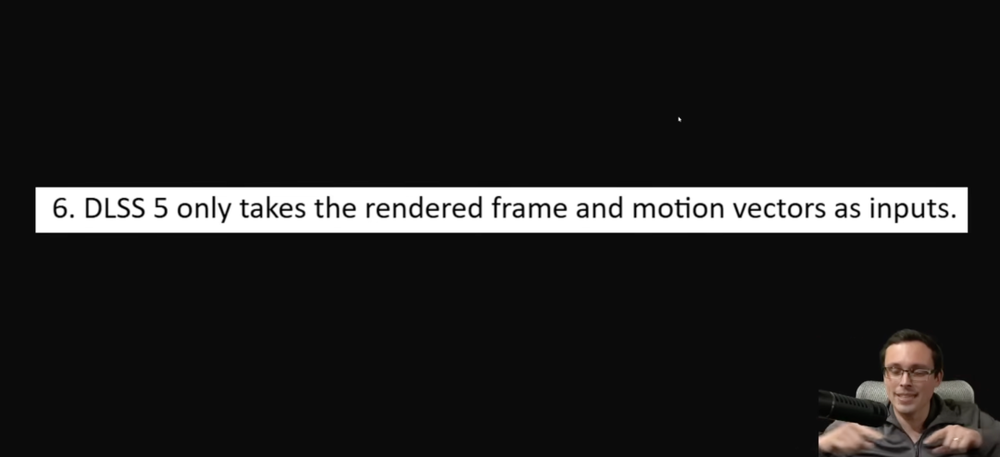

第一个问题:DLSS 5实际上只是以单帧2D图像+运动矢量作为输入?

英伟达布道师的回答:是的。

这就意味着,黄仁勋以及英伟达官方此前宣称的所谓「重建光照」、「不影响底层几何」、「增强基于物理的材质渲染」等等,其实根本没有。

英伟达官方营造出一种模型直接深入游戏引擎,对游戏素材几何有深度感知的「错觉」,但实际上DLSS 5目前唯一的输入,只有一张截图,和运动矢量(用于渲染下一帧,让画面连续性更好)。

第二轮追问:英伟达此前说的「底层几何和材质不变」,那么DLSS 5模型是否真的理解3D几何、深度等细节,或者只是分析2D帧?

回答:DLSS 5通过端到端训练,实现对复杂场景语义的完整理解——完全通过分析单帧来完成

可以看到,这位英伟达布道师并没有直接回答Owen的提问。但是他所说的「完全通过分析单帧来完成」已经揭开了真相:DLSS 5并没有跟游戏引擎合作,甚至不需要游戏引擎,它的唯一输入,就是当前帧。

第三轮追问:在官方视频演示中,有一个角色的发型发生了变化,似乎对原人物模型的几何和材质进行了篡改,而非简单的光照增强。而且,人物的妆造也改变了。换句话说,这很像一个AI图像生成器,对人物进行了重新诠释。

回答:「底层几何不变」,同时补充「这还是非常早期的技术预览」。

「几何不变」指的是游戏引擎渲染的那一帧,但你根本看不到那一帧。开了DLSS 5之后,你看到的是AI在那张图上面重画的结果。

「几何不变」和「你看到的画面不变」是两回事。这个回答回避了真正的问题。

至于所谓的「早期技术预览」——英伟达既然决定在DLSS 5当前这个水平程度上将其公开发布,而且还是在每年最重要的GTC大会上,这又意味着什么呢?是不是对此已经满意,达到可发布的程度了呢?

第四轮追问:英伟达说DLSS 5「增强材质PBR属性」,它是真的读取了美术师在游戏引擎里设置的金属度、粗糙度、法线贴图,还是只是从2D图像里猜?

回答:DLSS 5只接受渲染帧和运动矢量作为输入。材质属性是从渲染帧中推断出来的(inferred from the rendered frame)。

这还能说什么呢?黄仁勋所谓的「几何层面的生成控制」,和实际情况根本对不上。

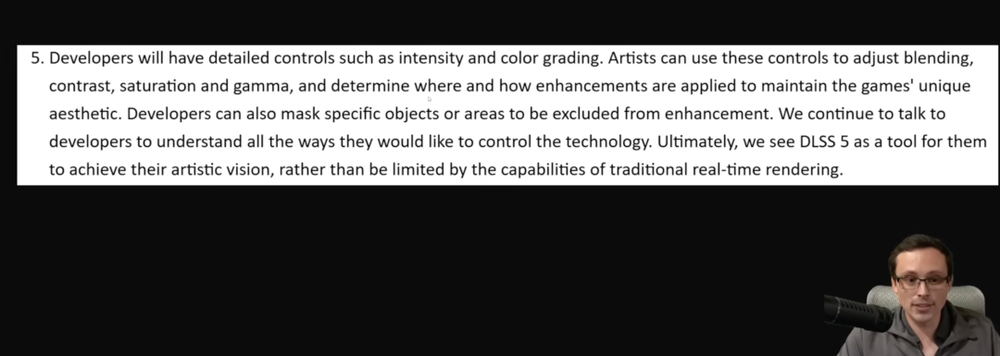

第五轮追问:以《生化危机》的格蕾丝为例,她是一个带着创伤赶赴命案现场的角色,DLSS 5让她看起来像是化了妆准备去约会。开发者能不能告诉DLSS 5「不要给她加妆」?开发者到底拥有多大的控制权限?

回答:开发者有强度调节(原帧与AI输出之间的混合比例)、颜色分级(对比度/饱和度/伽马)、遮罩功能。英伟达会持续与开发者沟通,了解他们希望如何控制这项技术。」

不管将来有没有,至少就目前来看,开发者是没有任何控制权的。

包括卡普空等厂商在内,在GTC之后都表示被英伟达杀了个措手不及,自己还是第一次看到DLSS 5的demo。英伟达之前根本没有联系过他们,没有提供技术预览。开发者也根本不知道自己能控制多少、甚至压根有没有控制。

第六轮追问:DLSS 5效果仅限屏幕空间内吗?它是否对屏幕/当前帧之外的环境场景有任何程度的感知?

回答:DLSS 5只用当前帧和运动矢量作为输入。

这句话真的已经说累了。DLSS 5根本不是什么所谓几何级的渲染,它跟游戏引擎,至少目前来看,没有半毛钱的关系。英伟达官方的宣传试图营造出它能够读取几何数据,完全是误导。

事已至此,如何洗地?

有一种辩护逻辑是:DLSS 4及以前的超分辨率技术,本质上也是从低分辨率帧生成高分辨率帧,同样没有「直接读取几何数据」,但大家都接受了它。DLSS 5只是在同一个思路上往前走了一步。

这个逻辑,在技术层面是成立的。超分辨率和DLSS 5的神经渲染,确实都是属于生成技术,都是「无中生有」。

但它绕开了真正的问题。超分辨率的目标是「还原开发者想要你看到的画面」,DLSS 5的目标是「用AI觉得更好看的方式重新渲染这个画面」。

一个是工具,另一个是强行干预。

前者尽量让你看不出来它存在,后者把存在感做成了卖点,把「让画面变得更真实」作为demo里最醒目的效果。

GTC的直播超过一百万人观看,点赞比仅16%,评论区留下了超过8.2万条反对意见。《生化危机Requiem》演示里第一个镜头就是格蕾丝,她的脸在DLSS 5之后变成了那种你在AI生成人像里见过一千次的「超级光滑光泽皮肤」。

有人把它拿来和Snapchat美颜滤镜并排放,效果确实很像。

游戏美术是一件极其精细的工作。一个角色的皮肤该有多少光泽,头发的渲染是写实还是风格化,场景里光线的色温是暖调还是冷调,这些都不是随机决定的,背后有具体的审美判断、技术选择、甚至叙事用意。

游戏开发者花时间标注材质的物理效果、调整光照模型、做视觉风格指南——这些不应该被当做简单的、可以被替代和优化的重复性工作。这些工作,也是开发者艺术表达的体现。

游戏开发者做这些事情,期待着最终玩家看到的东西正如他们所设计的那样。夸张一点来说,这何尝不是一种创作者和受众之间的交流?

现在,DLSS 5横空出世,在这条道路设了个卡。

DLSS 5根本读取不了美术师的意图,它可能压根也不在乎。它直接读取最终渲染结果,然后在上面又强加一层它认为「更真实」「玩家更想看」的东西。开发者、设计师、美术师的表达自主权,被DLSS 5剥夺了。

这年头,设计师和艺术家们已经够难了。AI生成工具的浪潮里,每个人都在担心自己会被替代,恐慌情绪蔓延。

DLSS 5横空出世,用一层AI滤镜抹在他们的工作成果上,并宣称这才是真正的先进,还说反对的人「完全错了」。

错了的究竟是谁?