本文来自微信公众号: 歪睿老哥 ,作者:歪睿老哥

你有没有发现一个很奇怪的现象。

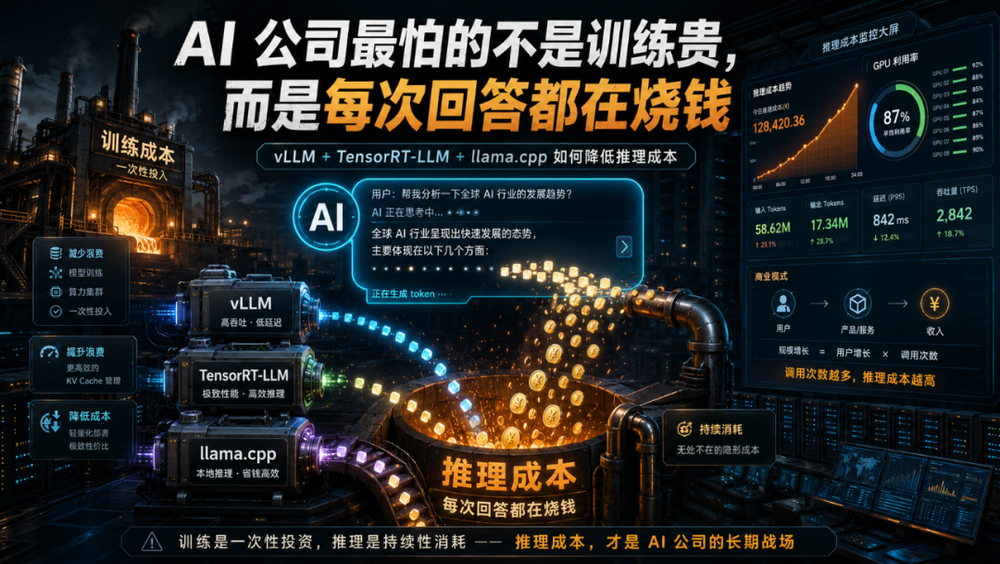

AI产品越受欢迎,公司反而越焦虑。

传统软件公司最喜欢的一种模式叫规模效应。

一个SaaS产品开发出来之后,新增用户的边际成本很低。用户越多,收入越多,利润率越来越好。

AI产品不是这样。

每个用户都在消耗算力。每次对话都在生成token。每次生成图片、视频、代码,都在调用昂贵的硬件。

这让它有点像会说话的游戏。用户每玩一分钟,公司都要付实时计算成本。

这就带来一个尴尬的局面:免费用户越活跃,亏得越快。

付费用户如果重度使用,也可能不赚钱。

企业客户如果调用量巨大,合同价格必须精细到每千个token多少钱。

模型效果越好,用户越爱用,成本压力反而越大。

过去两年,AI行业最喜欢比较的东西是模型能力。

谁的模型更聪明。

谁的上下文更长。

谁的benchmark更高。

这些当然重要。

但当模型能力逐渐接近,另一个指标会变得越来越关键。

每token成本。

谁能用更低成本生成同等质量答案,谁就有更大商业空间。

这就像航空公司。所有航空公司都能把乘客从A城送到B城。

但谁的油耗更低、上座率更高、调度更好,谁就能活得更久。

AI公司也是一样。

模型能力是飞机能不能飞。推理成本是每趟航班赚不赚钱。

你可能觉得这没什么特别的。模型训练不是本来就贵吗?

训练确实贵。某个大模型训练用了多少GPU,花了多少万美元,跑了多少天。这些数字很震撼,容易传播,也很像科技新闻里的重型烟花。

但商业公司真正害怕的,不只是训练成本。

因为训练再贵,至少是阶段性的。一个模型训练完,可以用一段时间。一次大版本升级,可以隔几个月。训练成本虽然高,但它像研发投入,可以被摊销。

推理不一样。

推理是持续发生的。

用户问一句,算一次。

用户让模型改一篇文章,算一次。

用户让模型写代码,算一次。

用户开着语音助手连续聊天,每一句都在算。

企业客户把AI接进客服、搜索、办公流,每天可能调用百万次、千万次。

这时候AI公司面对的不是训练一次花多少钱,而是每个token要花多少钱、每个用户每天消耗多少算力、高峰期需要多少GPU才能扛住。

这就是推理成本的可怕之处。它不是一次性爆炸,而是每天滴血。

训练成本像一声雷。推理成本像屋顶漏水。雷响一下就过去,漏水会把整栋房子泡烂。

推理成本到底贵在哪里?

大模型回答一个问题,看起来只是屏幕上冒出一行字。但背后是一场高强度计算。

简单说,推理可以分成两个阶段。

第一个阶段叫Prefill。模型把你的prompt读进去,计算上下文。

第二个阶段叫Decode。模型不能一次性把整篇答案吐出来,而是一个token一个token地生成。

这就带来一个问题:大模型生成越长,计算越久。用户越多,并发越高。上下文越长,内存压力越大。模型越大,需要的显存和计算越多。

更麻烦的是,大模型推理不只是算力问题,还是内存问题。

每个请求都要保存中间状态。其中最重要的是KV Cache。

你可以把KV Cache理解成模型读过上下文之后留下的工作笔记。有了这份笔记,模型生成下一个token时就不用从头再读一遍全部上下文。

但问题是,用户越多、上下文越长,KV Cache占用的显存就越多。

显存是什么?在AI时代,它不是普通内存,而是GPU上最昂贵、最稀缺的黄金仓库。

很多时候,GPU的计算单元还没完全跑满,显存已经被KV Cache塞得满满当当。

于是,推理优化的核心问题变成了三个:

怎么高效地管理显存?

怎么让GPU少空转?

怎么用更少硬件服务更多请求?

说到这,有三个开源项目值得说。

它们分别代表三条路线,共同回答同一个问题:当大模型开始服务数亿用户时,如何让每一次回答不再像烧钞票。

vLLM、TensorRT-LLM、llama.cpp。

先说vLLM。

vLLM是一个高吞吐、内存高效的大模型推理与服务引擎。它最初来自UC Berkeley的Sky Computing Lab,现在已经发展成一个非常活跃的开源AI项目。

它最出名的技术,叫PagedAttention。

这个名字听起来有点硬核,但思想可以用一个生活化比喻解释。

传统KV Cache管理,有点像给每个用户分配一整间仓库。有些用户只放了几箱货,但仓库也被占了。有些用户货物越来越多,仓库又不够灵活。最终结果就是空间浪费严重,GPU显存被切得乱七八糟。

PagedAttention的思路,更像操作系统里的分页内存管理。不要给每个用户一整块连续大空间,而是把KV Cache切成小块,按需分配、灵活调度。

这样做的结果是:显存利用率更高,同一张GPU可以容纳更多请求,并发能力提升,吞吐量提升,单位token成本下降。

对于AI公司来说,这不是一个小优化。这直接关系到服务器账单。

假设一个模型原本需要100张GPU才能支撑某个业务高峰,如果通过推理框架优化,把同等吞吐压到70张或者80张,省下来的不只是硬件钱,还有机房、电力、运维、云租赁费用。

所以vLLM的意义不是让模型跑得快一点。它更像是大模型时代的高效调度系统。让每一张GPU少发呆。让每一份显存少浪费。让每一次回答少烧一点钱。

如果vLLM代表开源社区和云端服务优化路线,那TensorRT-LLM代表NVIDIA自己的软件护城河。

很多人以前觉得NVIDIA只是卖GPU的。但真正让NVIDIA难以替代的,是它从硬件到软件的完整生态。CUDA、cuDNN、TensorRT、Triton、TensorRT-LLM。各种模型优化、部署、推理工具链。

GPU是高速发动机。CUDA和TensorRT-LLM是高速公路、收费站、导航系统和维修体系。没有这些软件,GPU只是昂贵的硅片。有了这些软件,GPU才能变成AI工厂的生产线。

TensorRT-LLM的价值,就在于把模型推理深度贴合NVIDIA GPU的硬件特性。它会尽可能使用优化的kernel,减少无效计算,改善模型执行路径,在多GPU和多节点场景下提高推理效率。

这背后的商业逻辑非常清楚。只要AI公司继续用NVIDIA GPU,NVIDIA就不仅卖硬件,还能通过软件栈持续增强用户粘性。这是一种非常强的锁定效应。你买的不只是一张GPU,你买的是一整套让模型跑起来并且跑得足够快的工业系统。

但VLLM和TensorRT-LLM主要解决的是云端和服务器侧的问题。

还有另一条路线:能不能不把每次推理都放在云端?

这就是llama.cpp的意义。

llama.cpp的官方介绍非常直接:主要目标是在本地和云端的广泛硬件上实现state-of-the-art的LLM推理。

这句话背后的趋势是:大模型正在从云端向本地、边缘设备、个人电脑、手机、工作站下沉。

过去,运行大模型像进入云端神殿。你需要昂贵的GPU,需要服务器,需要复杂环境。llama.cpp把这件事变得更接近普通开发者。它使用C++,强调轻量、可移植、部署简单。通过量化等方式,它可以让模型在更低内存、更普通的硬件上运行。Qwen文档中也提到,它支持2-bit到8-bit量化,用于更快推理和减少内存占用,并支持CPU加GPU混合推理。

这件事对AI商业模式很重要。

因为如果所有请求都在云端推理,AI公司永远要承担巨额服务器成本。但如果一部分推理可以转移到本地呢?

比如个人电脑本地助手。比如手机端小模型。比如企业内网私有部署。比如边缘设备上的语音、视觉、文本处理。没有网络时也能运行的AI应用。

这会改变成本结构。

云端推理,AI公司出电费。本地推理,用户设备出电费。

云端推理需要集中购买GPU。本地推理可以利用已经存在的CPU、GPU、NPU。

这不是说云端会消失。大模型、复杂任务、高质量推理仍然需要云端。但llama.cpp代表了一种方向:不是所有AI推理都必须回到数据中心。一部分推理会留在用户身边。

这就像计算机历史上的钟摆。大型机时代,计算集中在中心。PC时代,计算下放到个人。云计算时代,计算又回到数据中心。AI时代,计算可能再次分裂:大模型在云端,小模型在端侧,私有模型在本地。

llama.cpp就是这次回摆里的一个重要信号。

把这三个项目放在一起看,你会发现它们其实在回答同一个问题:AI推理的账单,怎么降下来?

但它们的答案不同。

vLLM的答案是通过更好的调度、更高的吞吐、更高的显存利用率,让云端GPU服务更多用户。

TensorRT-LLM的答案是深度优化NVIDIA GPU上的模型执行,把硬件潜力榨出来,让推理更快、更适合生产部署。

llama.cpp的答案是让模型跑到更广泛的硬件上,尤其是本地和端侧,让一部分推理不再依赖昂贵云端GPU。

这三条路线,其实代表了AI基础设施的三个方向:云端效率化、硬件软件一体化、推理本地化。

未来AI公司会同时用这三种方式降低成本。大型模型放在云端,用vLLM、TensorRT-LLM这类框架提高GPU利用率。中小模型放在企业私有环境,减少对外部API依赖。轻量模型放在本地设备,用llama.cpp或类似框架运行。

复杂任务上云,简单任务本地解决。高价值请求用强模型,低价值请求用便宜模型。

这会形成一个全新的AI成本分层体系。不是所有问题都值得请最贵的模型回答。不是所有用户请求都值得占用最贵的GPU。不是所有推理都应该发生在同一个地方。

AI商业模式的成熟,可能就藏在这种分层里。

你想想看。

今天很多AI产品都有一个尴尬处境:用户越多,成本越高。

这让AI产品有点像会说话的游戏。用户每玩一分钟,公司都要付出实时计算成本。

这带来一个商业难题:免费用户越活跃,亏得越快。付费用户如果重度使用,也可能不赚钱。

所以AI公司不能只追求用户增长。它还必须追求更低的每token成本、更高的GPU利用率、更精细的模型路由、更便宜的推理框架、更合理的订阅价格、更强的缓存和复用机制、更高比例的端侧执行。

否则,AI产品可能会出现一个奇怪悖论:越受欢迎,亏得越快。

这就是为什么推理框架会从幕后走到台前。vLLM、TensorRT-LLM、llama.cpp这类项目,不只是工程师的工具。它们正在影响AI公司的毛利率、定价方式和产品形态。

我读到这儿的时候,突然觉得很有意思。

AI行业最容易被看见的是什么?是模型。是发布会、排行榜、参数、benchmark、演示视频。

但真正决定公司能不能活下去的,往往是那些看不见的东西:GPU利用率、显存管理、KV Cache、模型量化、推理调度、服务吞吐、端侧部署、每token成本。

训练模型,是造出一头巨兽。推理优化,是让这头巨兽每天吃得起饭。

如果说大模型训练是AI时代的炼金术,那么推理优化就是AI商业化的账房先生。账算不平,模型再聪明也难赚钱。账算得好,每一次回答都可能变成可持续的生意。

未来AI推理不会只有一种形态。它会变成一张分层网络。

最上层,是云端巨型模型。负责最复杂、最难、最高价值的任务。

中间层,是企业私有部署和行业模型。负责客服、办公、代码、金融、医疗、制造等垂直场景。

最底层,是本地和端侧小模型。负责日常助手、简单问答、语音识别、摘要、隐私任务、低延迟交互。

在这个网络里,vLLM、TensorRT-LLM、llama.cpp这类项目会分别占据不同位置。

它们不是互相替代,而是共同拼成AI推理基础设施的三块拼图。

未来真正厉害的AI公司,可能不是只拥有一个大模型,而是拥有一整套推理成本控制系统。

什么时候用大模型,什么时候用小模型。什么时候走云端,什么时候走本地。

什么时候缓存答案,什么时候调用工具。什么时候让多个请求合批。

什么时候牺牲一点模型质量换取十倍成本下降。

这才是AI商业化的深水区。

AI行业最容易被看见的是模型。发布会、排行榜、参数、benchmark、演示视频。

但真正决定公司能不能活下去的,往往是那些看不见的东西。

vLLM、TensorRT-LLM、llama.cpp。三个开源项目。

它们不站在聚光灯下,不制造热搜,不产生令人兴奋的视频演示。但它们正在影响每一家AI公司的财务报表。

因为AI从实验室走向亿万用户,每一句回答,究竟由谁买单?

未来AI公司最怕的,也许不是训练贵。而是用户每问一句,后台就有一枚硬币掉进看不见的井里。

推理成本,就是那口井。

谁能把井填上,谁才有机会把AI变成真正赚钱的生意。