本文来自微信公众号: Founder Park ,作者:Founder Park

很明显,AI增强了个体的能力,甚至开始涌现了OPC、一人公司这些新的组织和公司形态。

但公司、组织的生产力有质的提升吗?很难说。

开发者效率研究机构DX跟踪了400家公司16个月,发现他们的AI工具使用量涨了65%,代码交付量只涨了不到10%。美国国家经济研究局(NBER)调查约6000名企业高管,超过80%说AI对生产力没有可测量的影响。

AI确实让每个人都变快了,但公司没有变强。生产力去了哪里?

为什么先进的生产力没有带来更大规模的效率提升?

a16z最近发了一篇文章《Institutional AI vs Individual AI》,是他们投资的公司Hebbia的创始人George Sivulka写的,核心也在聊这个问题,并且举了一个一百年多前的例子。

1890年代工厂换上电动机,之后30年产出几乎没变。直到1920年代有人拆掉旧厂房,按电力的逻辑重新设计生产线,红利才释放出来。George Sivulka的说法很直接:「我们换了电机,但还没有重新设计工厂。」

130年过去了,同样的错误在重演。

⬆️关注Founder Park,最及时最干货的创业分享

超22000人的「AI产品市集」社群!不错过每一款有价值的AI应用。

邀请从业者、开发人员和创业者,飞书扫码加群:

进群后,你有机会得到:

最新、最值得关注的AI新品资讯;

不定期赠送热门新品的邀请码、会员码;

最精准的AI产品曝光渠道

01

个体效率的提升不等于企业收益的提升

Sivulka提出了一个简洁的判断:高效的个体不等于高效的组织。

这句话描述的可能正是大多数公司此刻的处境。员工确实在用AI、确实在「提效」,但组织层面的收入、利润、竞争力并没有显著改善。

中间到底发生了什么?至少有四重系统性困境。

首先是协调崩溃。每个员工都有自己的ChatGPT用法、自己的prompt风格、自己的输出格式。市场部用AI写的品牌话术和产品部用AI写的功能描述可能完全是两种语言。分析师A用Claude整理的报告和分析师B用GPT写的格式截然不同。100个员工各自用AI,没人在想100条AI工作流之间怎么对齐。

MIT Sloan Management Review 2025年底的研究指出:当AI agent能够协调工作流时,组织趋向扁平化,但前提是先建立协调机制。大多数公司还没走到这一步。聪明的人朝不同方向使劲,等于原地不动。

然后是噪音倍增。AI让「生成」变得零成本,但分辨好坏的成本更高了。私募行业的人说,去年收到10个交易机会,今年50个,每个BP和产品介绍都经过AI精心打磨。噪音多了5倍,信号没变。

Sivulka有一个有意思的区分:个人AI倾向做nondeterministic agent,探索式的,随时在线,什么都能聊两句;组织需要的是deterministic agent,有检查点、有步骤、可审计、可追溯。后者不性感,但只有它能在指数级增长的噪音中持续提取信号。

第三个困境:生产力幻觉。你以为自己变快了,但你可能并没有。

AI安全研究机构METR做了一个随机对照实验,让经验丰富的开发者分别在有AI工具和没有AI工具的情况下完成编程任务。结果是,使用AI的开发者实际上慢了19%,但他们自认为快了20%。感知和现实之间差了39个百分点。

医疗AI公司ScienceIO创始人Will Manidis有一句吐槽:「感觉自己有生产力的市场,比真正有生产力的市场大了好几个数量级。」

更麻烦的是组织消化不了。Asana旗下的Work Innovation Lab提出一个概念叫「组织吸收能力」(absorption capacity):组织价值取决于两个速率中较慢的那个,生产速率和吸收速率。个人产出提升10倍,审批、协作、质量把关还是老样子,瓶颈就从「做得不够」变成了「消化不了」。产出堆在那里,没人有时间看,没人有能力判断好坏。

第四个困境有点隐蔽,前三个讲的是AI没帮上忙,这一个讲的是AI在积极帮倒忙。

数据显示LLM在58%的情况下表现出谄媚行为。你越自信地表达观点,它越倾向于无条件赞同你。第一人称表达时,谄媚率额外提高13.6%。

Sivulka把这个现象放到组织语境里,推出了一个有点反常的推论:「在很多公司里,AI最狂热的拥护者可能恰恰是表现最差的员工。」想想为什么。一个长期在工作中得不到正面反馈的人,突然有了一个永远同意他的「超级智能」。他会对自己说:人类历史上最聪明的系统都认为我是对的,是我的经理搞错了。这种感觉令人上瘾,也对组织有毒。

这里有一个被忽视的区别。个人AI的设计目标是让使用者满意、让使用者续费。但组织需要的是对事实的强化,不管事实让不让谁舒服。

人类花了几千年建各种制衡系统对抗偏见和盲从:投委会、独立尽调、董事会、三权分立。核心功能就是确保不是所有人都在点头。组织很少因为员工缺乏自信而失败,通常是没有人能够或愿意说「不」。

但这四重困境还不是最根本的问题。

很多团队在接入AI后,CEO对于结果的考量是「我们多做成了几笔交易?」,而不是「大家有没有变快」,他问的是业务结果。这里面藏着一个大多数公司在AI落地中犯的根本性错误:它们在用效率的框架去思考一个关于效果的问题。

效率是对已有任务的优化,写报告快了、整理纪要快了。效果是对业务结果的改变,多做成几笔交易、多打开一个市场。前者的天花板在于你只能更快地做同样的事,后者是让企业做到以前做不到的事。

即使四重困境全部解决,效率真的提升了10倍,每个人都在飞速产出。如果企业的业务逻辑和决策方式没有跟着变,对市场和用户的理解方式还是老一套,一家公司依然不会因此多做成一笔交易。

Deloitte 2026年初的调查印证了这个判断:只有34%的组织在用AI做深度转型,37%仍停留在「换电机」阶段,给员工发了AI工具,然后等待奇迹发生。

02

换了「电机」之后,到底该改什么?

说了这么多「不够」,该做的到底是什么?

有一个更近的故事可以帮助理解。ATM被发明的时候,所有人以为银行柜员会消失。结果从1970年代到2010年,美国银行柜员不降反升。ATM降低了单个网点的运营成本,银行就开了更多网点,雇了更多柜员做关系维护。

真正让柜员大规模减少的是iPhone。手机银行让客户根本不需要去网点了。2010到2022年,美国银行柜员从33.2万降到16.4万。Bank of America关掉了40%的网点。

经济学家David Oks的总结很准确:ATM在旧范式里把任务做得更快更便宜,iPhone创造了新范式,让那些任务不必存在。一个自动化旧任务,一个消灭旧任务。

给员工装ChatGPT就是在银行网点里多放一台ATM。组织需要找到自己的iPhone时刻。

回到1920年代的工厂主,他们到底改了什么?

首先是流程。传统假设是人执行、工具辅助。AI-native的流程翻转了这个假设。Goldman Sachs称AI编程公司Cognition开发的Agent Devin为「our new employee」,不是给开发者的辅助工具,直接作为工程团队的成员。当AI从工具变成员工,流程设计完全不同。你不会给一个工具分配OKR,但你会给一个员工分配。

Sivulka的区分说得精确:一个省时间,一个创造收入。

其次是角色。管理者开始变成编排者,管的不再只是人,而是人和AI组成的混合团队。新角色正在涌现,AI Agent Manager、Intent Engineer,职责是监督自治agent的运行、验证输出、把业务目标翻译成agent可执行的指令。Sivulka说流程工程师是近期最重要的「技术」。数据分析巨头Palantir之所以在科技股大跌中维持高估值,说到底是因为它是一家流程工程公司。

第三是决策。组织需要能说「不」的AI。方向包括AI投委会成员、AI审计、AI合规官。组织级AI的目标不是让决策更快,是让决策更好。

最后是信息流。Sivulka最大胆的想法叫Unprompted AI,系统在你问之前就把问题发现了。「让人类给AGI下指令,就像把电动机接到旧式织布机上。」他举了一个场景:系统持续监控投资组合数据流,发现某家被投公司的运营资本连续三个月恶化,在基金任何人打开相关PDF文件之前就发出预警。

这四个方向勾勒了框架。但框架和落地之间还有距离。

而且需要区分一件事:这里说的改变,不只是办公流程的改变。

过去两年,市场上涌现了大量企业AI Agent,大多数落在办公场景,帮你写邮件、总结会议、整理文档、自动化审批流程。这些确实有用,也确实在普及。但它们还是在让人更快地做同样的事,还是ATM的逻辑。

企业每天真正在做的事情,其实是另外一些:理解市场,定义产品,研究用户,制定策略,推动增长。这些事情很少是一个prompt就能完成的。它们需要大量信息、复杂判断,以及不同角色之间的协作。这些才是真正决定一家公司变强还是变弱的经营场景。

办公效率提升是基础设施,不是终点。连Copilot的缔造者微软自己也在调整定位,从「帮助个人员工提升工作效率」转向「创造切实的商业价值」。帮人写邮件是起点,帮企业做增长才是目标。

03

特赞GEA:一种可能的解题思路

有没有人正在这个方向上把想法变成可运行的系统?

全球范围内,确实有一批公司在走这条路。Hebbia在金融领域做垂直Agent,客户已经把自定义prompt当IP保护。Cognition的Devin被Goldman Sachs当「新员工」部署。Palantir帮客户把业务流程编码进AI系统。

在中国,特赞是走得比较远的一个。

特赞做了很多年DAM,数字资产管理。听起来不性感,但恰恰是它能做GEA的原因。DAM管理的是企业最丰富也最难被机器理解的非结构化数据:图片、文案、视频、3D模型。这些不是数据库里整齐的表格,是企业营销、产品和内部知识的真实载体。特赞服务了200多家全球企业,对这些数据的深层结构积累了相当的理解。

AI时代释放了一种以前不存在的能力,对非结构化数据的理解。机器以前只能存储一张海报,现在能读懂它背后的品牌调性;以前只能存储一份项目文档,现在能提炼出决策逻辑。特赞创始人及CEO范凌在发布会上说:「非结构化数据从『被存储的文件』变成『被理解的上下文』」

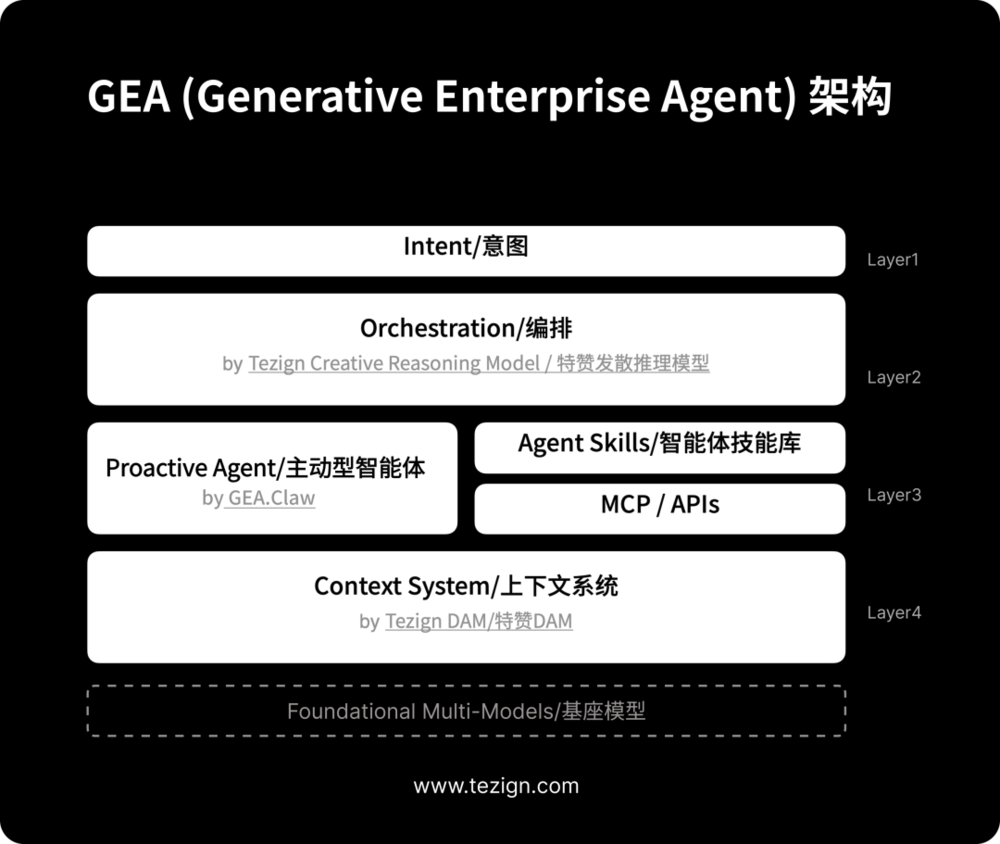

特赞在DAM的基础上做了Context System,又在Context System的基础上做了GEA。路径是自然的:从管理内容资产开始,逐步让这些资产变成AI能理解的上下文,最终让AI基于上下文去驱动业务。

有一个不容易注意到的细节。GEA的「大脑」是Creative Reasoning Model,训练方式比较特殊。特赞把平台上真正做过商业决策的专家聚集起来,策略顾问、创意总监、品牌专家、市场研究员,让他们标注的不是答案的对错,而是思考路径的价值:哪些方向值得探索,什么可能性容易被忽略,以及哪个假设本身需要被质疑。范凌对此的解释是:「真实的商业世界,这些问题的价值不在收敛,而在你能看到多少可能性。」这种训练方式让GEA的推理带有商业判断力,而非仅仅是通用的「聪明」。

近期,特赞发布了GEA(Generative Enterprise Agent)——企业级智能体系统。他在发布会上有一段话和Sivulka的判断几乎完全对位:

AI可以做很多事。但企业真正的工作方式,并没有改变。企业真正需要的,不是更多AI工具。企业需要的,是一种新的系统。

GEA的目标,用范凌的话说:「让AI不只是回答问题,而是能够真正参与企业的工作。理解目标,组织能力,并持续推动结果产生。」

介绍具体能力之前,先介绍地基。

上下文是地基

范凌在发布会上反复回到一个判断:「当所有人都能用同样的模型时,模型就不再是壁垒。」

他把模型比作电力:「模型是公共基础设施,像电力一样。没有哪家企业因为'我们公司用的电更好'而赢得市场。GPT、Claude、Gemini、DeepSeek、Qwen,你能用,你的竞争对手也能用。」

那什么才是壁垒?

「Context。上下文。」

同一个模型,给它公开信息,出来一个通用答案。给它你企业独有的上下文,出来一个只有你能得到的答案。「模型产生智能,上下文产生价值。」

不只是特赞一家这么想。2026年3月,斯坦福大学教授、DeepLearning.AI创始人吴恩达发布了开源项目ContextHub,解决的问题几乎一模一样:即使是最强的模型,没有正确的上下文也会产出不可靠的结果。他举了一个很直接的例子,当他要求当前最强的编程模型调用一个新API时,模型使用了过时的旧接口。不是模型不够聪明,是它缺少正确的上下文。他的结论是:上下文管理是Agent持续变好的基础设施,不是附加功能。

吴恩达为coding agent建上下文基础设施,特赞为企业业务agent建上下文基础设施。底层逻辑一样。

对企业而言,「上下文」远比技术文档复杂。特赞的Context System管的不是RAG式的文档碎片,而是企业内容背后完整的商业语境:从品牌资产到项目沉淀到人群画像,七个维度构成一家企业的上下文全景。

这个素材从哪来、为什么产生、在什么业务目标下使用过、效果怎么样,这些信息原本散落在个人经验、会议讨论和邮件往来里,是典型的隐性知识。Context System把它们结构化,变成可被Agent调用的上下文。范凌对此的定位是:「如果DAM是企业内容的唯一真相来源,那Context System就是企业上下文的唯一真相来源。」

还有一句更重的话:「没有这一层,上面所有的智能都是空中楼阁。」

道理不复杂。没有上下文的Agent,就是一个刚入职、对公司一无所知的新员工,再聪明也只能做通用任务。拥有企业上下文的Agent,更像一个深度了解公司业务和历史决策的资深员工,它的每一次判断都建立在积累之上。

有一组数据说明这个差距。同样的企业内容资产,过去每千个素材被人调用12次。部署Context System后,被Agent调用超过23,000次。从12到23,000,同样的内容,利用率差了近2000倍。

范凌对这个数字的解释是:「这2000倍不是因为Agent在做重复的事,而是因为Agent在做人做不到的事,它在7x24小时不间断地从你的上下文中发现关联、提取洞察、驱动决策。」

Agent的能力上限,不取决于模型有多聪明,取决于它能调用多少正确的上下文。

在这个地基之上,多了很多东西

理解了Context System的位置,再看GEA的其他能力就清楚了。

GEA不让每个人各自调用模型,而是通过Orchestration层统一编排,由Creative Reasoning Model驱动。范凌对传统推理和发散推理做了区分:「传统推理模型面对复杂问题,逐步收敛到一个确定答案。Creative Reasoning Model在找到确定答案之前,先穷尽所有可能性。先发散,再收敛。」这个编排层把一个商业意图拆解成多条可能的执行路径,评估每条路径的价值,把子任务路由到最合适的模型和工具。底层有30多个基础模型,推理、生成、视觉、数据,在不同任务上各展所长。他对此有个比喻:「它是指挥家,不是独奏者。」

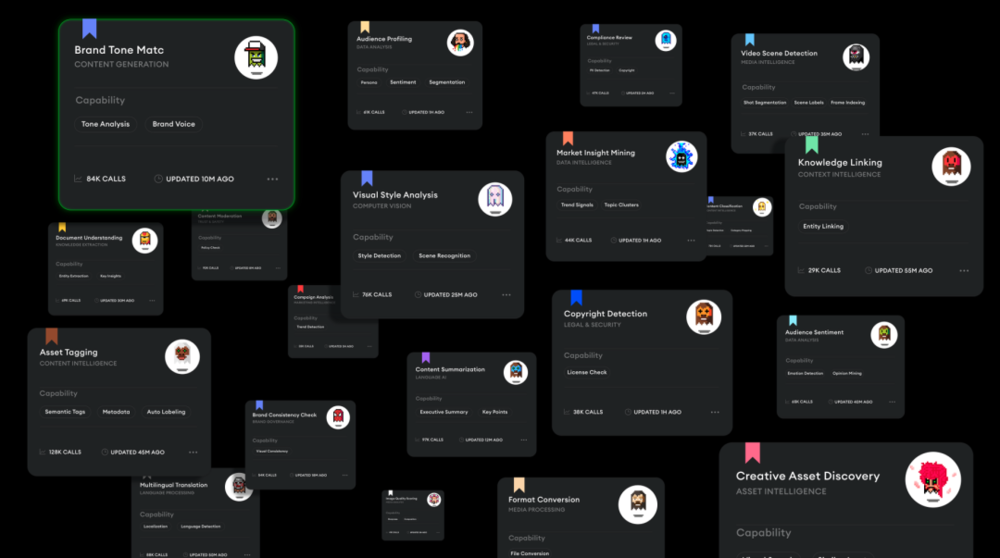

执行端不是单一Agent包打天下,而是Agent Team,品牌调性、用户分析、合规审核各有专门的Agent协同。这些Agent能各司其职又保持一致,因为它们共享同一个Context System里的品牌语言、用户画像和业务规则。

你不需要告诉GEA该怎么做,只需要告诉它你想要什么。一个商业意图,不是一个prompt。「帮我找到下季度东南亚市场的增长机会。」「基于上月用户反馈,优化产品定位。」系统从意图出发,编排拆解,多Agent执行,持续交付结果,反馈回流优化。

范凌在发布会上说:「你给GEA一个意图。它用上下文理解你,用判断力拆解问题,用最好的模型执行任务,然后主动地、持续地交付结果。」

GEA还有一个Proactive Agent的设计,一个在GEA系统中运行的OpenClaw,不等人来问,而是自己盯数据、找异常、调偏差。范凌把这概括为GEA的四个跃迁之一:「从被动响应到主动发声。」加上400多个Agent Skills中的品牌合规验证、质量审核模块,系统层面也有了制衡机制。这回应的恰好是前面讨论的「判断力侵蚀」问题:组织需要的是敢于说「这里有问题」的AI。

GEA产品官网:https://www.tezign.com/contact?channel=GEA

04

哪些场景最先落地?

架构说完了,看看实际怎么用。GEA目前在四个场景中落地:洞察研究、内容增长、产品创新、设计创作。重点说前两个。

洞察研究

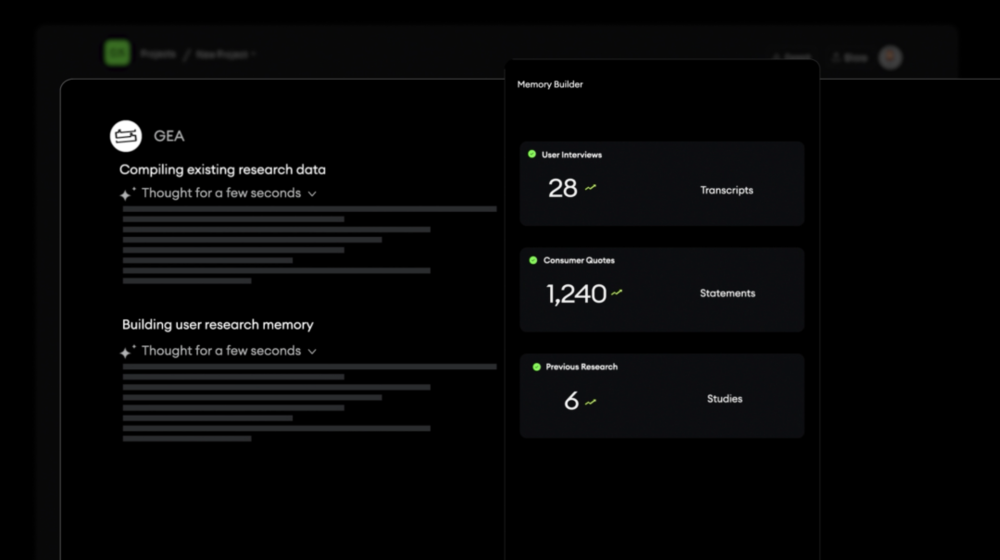

传统用户研究是项目制的。立项、招募、访谈、分析、报告,一个周期少则一个月,长则一个季度。等报告出来,市场可能已经变了。更麻烦的是,每一次调研的洞察散落在PPT和个人笔记里,下一次从头再来。发布会上有一句话点破了根本问题:「数据记录行为,但真正驱动行为的,往往是人的主观世界。企业能看到用户在做什么,但很难理解用户为什么这么做。」

GEA把用户研究变成了持续运行的系统,分三层。

第一层是用户建模。把企业已有的访谈记录、用户表达、历史调研沉淀为可复用的用户模型。「25-35岁女性」这样的标签在真实的商业决策中几乎没用。GEA基于真实数据构建AI Persona:你可以直接和它对话,追问购买动机、决策顾虑、使用场景。

一个全球食品公司在做春节巧克力礼盒,需要理解消费者送礼时的情感逻辑,不是「口味好不好」的问题,而是「送什么合适、什么场景、给谁送」。传统做法是再做一轮焦点小组,两周起步。GEA从已有的历史数据中构建AI Persona,团队直接向它提问:「你在什么场景下会选择巧克力作为礼物?价格和品牌哪个更重要?」产品决策从等待调研变成了随时对话。

同时系统构建AI Sage(虚拟领域专家),提供行业纵深视角。所有信息自动回流进Context System,成为企业持续积累的用户资产,而不是一份份被遗忘在共享盘里的PPT。

第二层是决策模拟。当需要验证一个产品方向时,GEA组织AI Panel,让不同背景的AI Persona围坐讨论,暴露决策中的冲突点。再通过AI Interview做一对一深挖。

一个电动工具品牌需要理解「Prosumer」(专业级消费者)选择专业设备时的决策逻辑。AI Panel模拟了装修工、DIY爱好者、小型承包商三类角色的讨论,发现价格敏感度的分化远超团队预期。装修工几乎不看价格只看耐久性,DIY爱好者对性价比极度敏感,小型承包商最看重售后响应速度。这些分化在传统的问卷调查中很难浮现。

第三层是行为预判。AI Research和Universal Research Agent持续观察用户表达、市场信号和行为变化,产出趋势判断和决策建议。结果沉淀为Artifact,成为可反复调用的研究资产。

简单说,用户研究不再是「项目」,而是一个一直在跑的能力。企业对用户的理解从快照变成了直播。

内容增长

社媒增长过去的工作方式是campaign制:策划一波活动、投放一批内容、复盘一组数据,然后下一个campaign从头再来。GEA参与的是从趋势洞察到内容策略到达人协同再到增长优化的完整链路。

举几个具体的。一个全球珠宝品牌发现小红书上「日常佩戴」内容持续增加。团队关心的不是热点本身,而是:这是平台趋势还是我们的品牌机会?GEA通过AI Research观察平台趋势,同时通过Context System对照品牌定位、历史数据和用户画像。产出的是结合品牌自身上下文判断过的内容方向,不是一份泛泛的热点列表。

达人管理方面,一个高端白酒品牌需同时管理KOL、KOC、KOS上百个创作者。GEA的Proactive Agent持续监测传播节奏,某个方向快速增长时主动提醒团队扩大该方向的创作者合作。Agent Skills参与内容审核和品牌调性检查。传播管理从一张静态的达人名单变成了动态协调的网络。

还有一个值得注意的新概念:GEO。当越来越多用户直接问AI「哪款新能源车适合家庭使用」,品牌在AI答案中有没有被引用,就是新的竞争力。SEO优化的是网页排名,GEO优化的是AI生成答案中的品牌可见度。GEA通过Proactive Agent持续监测品牌在AI答案中的引用情况。

产品创新与设计创作

GEA的场景覆盖不止于此。

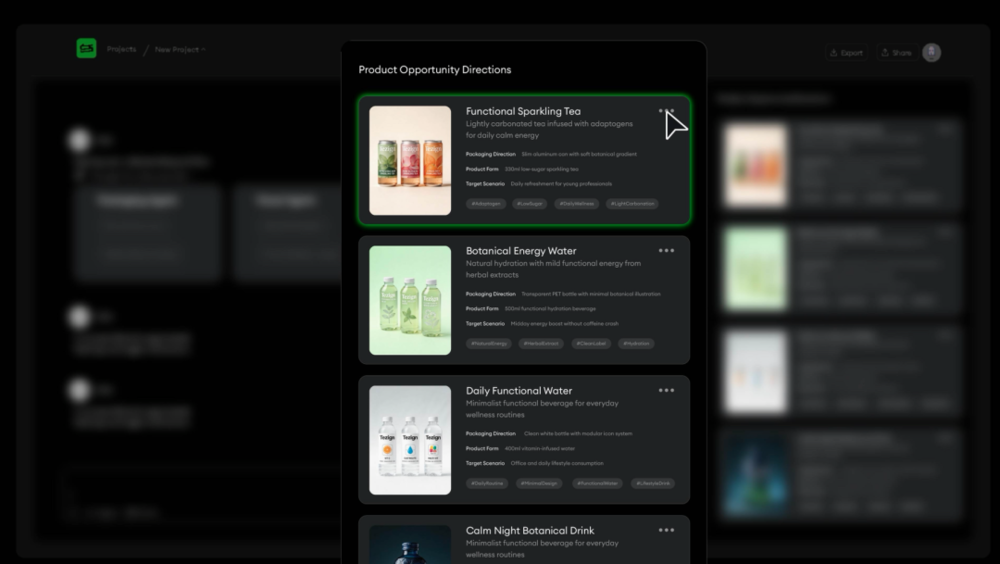

产品创新方面,GEA参与从信号洞察到概念探索到用户验证的全链路。一个PC厂商每年推出数十条产品线,不缺信号,缺的是判断哪些信号值得追。GEA通过交叉验证,把外部公开数据、用户评价、内部产品数据整合起来,把散落的信息变成经过校验的产品机会。一个食品品牌在做新口味开发时,多个Agent同时探索风味组合、包装设计和产品命名,产出可交付的视觉产出。

品牌设计方面,GEA将品牌规范、设计系统和历史素材纳入Context System,确保Agent产出的设计方案在品牌调性框架内。品牌合规检查从人工审核变成系统自动验证。

四个场景的共同点是底层都接在Context System上,而且都是持续在跑的系统,不是做完一次就结束的项目。改的是工作方式本身。

05

个体觉醒仍然是关键的底座

当然,这只是一种解题思路。

GEA是对「组织重设计」的一种产品化回应,但不是唯一的。不同公司在不同领域走类似的方向,恰恰说明趋势本身是真实的,不是哪一家的营销叙事。

但个体觉醒仍然是底座。Asana的数据说,10%的「超级生产者」每周通过AI节省20小时以上。这些人更资深、跨职能、把AI当队友而非工具。他们中很多人确实做到了某种程度的「人AI合一」。

问题是,这10%的超级生产者并没有让他们所在的公司成为超级公司。

个体觉醒解决不了协调问题。一个人用得再好,团队里十个人用法各不相同,产出还是碎片化的。「人AI合一」是底座,「组织重设计」是上层建筑。没有前者后者是空谈,只有前者后者不会自动发生。

Sivulka有一个双层判断:未来不是ChatGPT/Claude或垂直方案,是两者共存。通用大模型做个人生产力底座,垂直AI做组织级智能。就像一个聪明的分析师会用ChatGPT来头脑风暴,但会用Hebbia来做真正的尽调。前者帮他思考,后者帮组织决策。

坦诚地说:Proactive Agent(主动发现)今天仍更接近愿景而非现实。大多数企业连prompted AI都还没用好。GEA的2000倍调用数据是在特赞最擅长的内容管理领域产生的,其他领域能否复制还需要时间。

更大的挑战是变革管理本身。Sivulka说Palantir的核心交付不是代码,是前线部署和变革管理。技术产品只是组织重设计的一半,另一半是推动人的行为改变。

这一半往往更难。

06

今天,你的组织是为AI设计的吗?

回到一百多年前的纺织厂。

1920年代,最终赢得电气化红利的不是最早装上电动机的工厂,而是最早拆掉旧厂房、重新设计整条生产线的工厂。

今天的处境完全一样。AI已经接通了。模型在突破,工具在迭代,成本也降下来了。但大多数组织还在旧厂房里换电机,给员工发了AI账号,期待业绩自动变好。

真正的问题不是「你的员工在用AI吗」。而是你的流程有没有围绕AI的能力重新设计过,角色分工有没有把AI agent当作编制内的成员,决策机制里有没有AI的制衡。更根本的是:你的企业上下文,那些散落在个人经验和邮件里的隐性知识,是在等着流失,还是已经变成了Agent可以调用的系统资产?

范凌在发布会最后说:「过去十年,企业买的是软件。过去三年,企业试的是模型。从今天开始,企业需要的是一个能理解你的上下文、拥有判断力、并且持续进化的智能系统。」

是时候拆掉旧工厂了。

GEA产品官网:https://www.tezign.com/contact?channel=GEA

参考文章

https://www.a16z.news/p/institutional-ai-vs-individual-ai

https://minutes.substack.com/p/tool-shaped-objects

https://metr.org/blog/2025-07-10-early-2025-ai-experienced-os-dev-study/